$ R ^ 2 $ משווה את ההתאמה של המודל הנבחר לזה של קו ישר אופקי (השערת האפס). אם המודל שנבחר מתאים יותר לקו אופקי, אז $ R ^ 2 $ הוא שלילי. שים לב ש- $ R ^ 2 $ הוא לא תמיד הריבוע של כל דבר, כך שהוא יכול להיות בעל ערך שלילי מבלי להפר כללי מתמטיקה. $ R ^ 2 $ הוא שלילי רק כאשר המודל שנבחר אינו עוקב אחר מגמת הנתונים, כך שהוא מתאים גרוע יותר מקו אופקי.

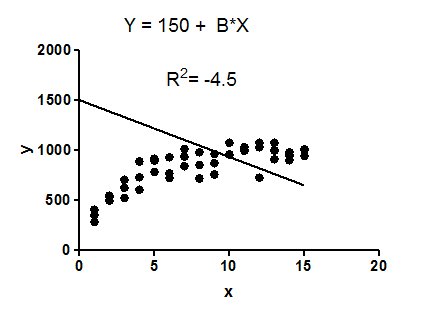

דוגמה: התאמת נתונים ליניארית מודל רגרסיה מוגבל כך שיירוט $ Y $ חייב להיות שווה $ 1500 $.

המודל אינו הגיוני כלל בהתחשב בנתונים אלה. ברור שזהו המודל הלא נכון, אולי נבחר במקרה.

ההתאמה של המודל (קו ישר שאולץ לעבור את הנקודה (0,1500)) גרועה יותר מהתאמה של קו אופקי. לפיכך סכום הריבועים מהמודל $ (SS_ \ text {reg}) $ גדול מסכום הריבועים מהקו האופקי $ (SS_ \ text {tot}) $. $ R ^ 2 $ מחושב כ- $ 1 - \ frac {SS_ \ text {reg}} {SS_ \ text {tot}} $. כאשר $ SS_ \ text {reg} $ גדול מ- $ SS_ \ text {tot} $, המשוואה הזו מחשבת ערך שלילי עבור $ R ^ 2 $.

עם רגרסיה ליניארית ללא אילוצים, $ R ^ 2 $ חייב להיות חיובי (או אפס) ושווה לריבוע מקדם המתאם, $ r $. $ R ^ 2 $ שלילי אפשרי רק עם רגרסיה ליניארית כאשר היירוט או השיפוע מוגבלים כך שקו "הכי מתאים" (בהתחשב באילוץ) מתאים גרוע יותר מקו אופקי. עם רגרסיה לא לינארית, $ R ^ 2 $ יכול להיות שלילי בכל פעם שהמודל המתאים ביותר (בהתחשב במשוואה שנבחרה, ואילוציו, אם בכלל) מתאים לנתונים גרוע יותר מקו אופקי.

בשורה התחתונה: $ R ^ 2 $ שלילי אינו אפשרות בלתי מתמטית או סימן לבאג מחשב. זה פשוט אומר שהמודל הנבחר (עם האילוצים שלו) מתאים לנתונים בצורה גרועה באמת.